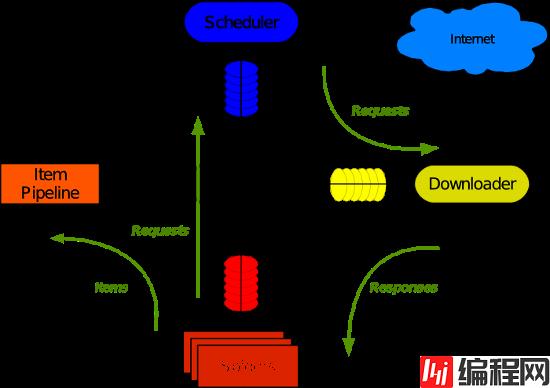

scrapy 使用了 Twisted 异步非阻塞网络库来处理网络通讯,整体架构大致如下(绿线是数据流向):

简单叙述一下每层图的含义吧:

- Spiders(爬虫):它负责处理所有Responses,从中分析提取数据,获取Item字段需要的数据,并将需要跟进的URL提交给引擎,再次进入Scheduler(调度器)

- Engine(引擎):框架核心,负责Spider、ItemPipeline、Downloader、Scheduler中间的通讯,信号、数据传递等

- Scheduler(调度器):它负责接受引擎发送过来的Request请求,并按照一定的方式进行整理队列,当引擎需要时,交还给引擎

- Downloader(下载器):负责下载Engine(引擎)发送的所有Requests请求,并将其获取到的Responses交还给Engine(引擎),由引擎交给Spider来处理

- ItemPipeline(管道):它负责处理Spider中获取到的Item,并进行进行后期处理(详细分析、过滤、存储等)的地方

- Downloader Middlewares(下载中间件):介于Scrapy引擎和下载器之间的中间件,主要是处理Scrapy引擎与下载器之间的请求及响应

- Spider Middlewares(Spider中间件):介于Scrapy引擎和爬虫之间的中间件,主要工作是处理蜘蛛的响应输入和请求输出

- Scheduler Middlewares(调度中间件):介于Scrapy引擎和调度之间的中间件,从Scrapy引擎发送到调度的请求和响应

Scrapy执行流程图:

用scrapy框架的时候,一定要先明白执行的顺序,代码已写好,程序开始运行~

- SPIDERS的yeild将request发送给ENGIN

- ENGINE对request不做任何处理发送给SCHEDULER

- SCHEDULER( url调度器),生成request交给ENGIN

- ENGINE拿到request,通过MIDDLEWARE进行层层过滤发送给DOWNLOADER

- DOWNLOADER在网上获取到response数据之后,又经过MIDDLEWARE进行层层过滤发送给ENGIN

- ENGINE获取到response数据之后,返回给SPIDERS,SPIDERS的parse()方法对获取到的response数据进行处理,解析出items或者requests

- 将解析出来的items或者requests发送给ENGIN

- ENGIN获取到items或者requests,将items发送给ITEMPIPELINES,将requests发送给SCHEDULER

注意!只有当调度器中不存在任何request了,整个程序才会停止,(也就是说,对于下载失败的URL,Scrapy也会重新下载。)

过程描述:

1.引擎:Hi!Spider, 你要处理哪一个网站?

2.Spider:老大要我处理xxxx.com(初始URL)。

3.引擎:你把第一个需要处理的URL给我吧。

4.Spider:给你,第一个URL是xxxxxxx.com。

5.引擎:Hi!调度器,我这有request请求你帮我排序入队一下。

6.调度器:好的,正在处理你等一下。

7.引擎:Hi!调度器,把你处理好的request请求给我。

8.调度器:给你,这是我处理好的request

9.引擎:Hi!下载器,你按照老大的下载中间件的设置帮我下载一下这个request请求。

10.下载器:好的!给你,这是下载好的东西。(如果失败:sorry,这个request下载失败了。然后引擎告诉调度器,这个request下载失败了,你记录一下,我们待会儿再下载)

11.引擎:Hi!Spider,这是下载好的东西,并且已经按照老大的下载中间件处理过了,你自己处理一下(注意!这儿responses默认是交给def parse()这个函数处理的)

12.Spider:(处理完毕数据之后对于需要跟进的URL),Hi!引擎,我这里有两个结果,这个是我需要跟进的URL,还有这个是我获取到的Item数据。

13.引擎:Hi !管道 我这儿有个item你帮我处理一下!调度器!这是需要跟进URL你帮我处理下。然后从第四步开始循环,直到获取完老大需要全部信息。

14.管道、调度器:好的,现在就做!创建项目:scrapy startproject proname

进入项目:cd proname

创建爬虫:scrapy genspider spiname(爬虫名) xxx.com (爬取域)

创建规则爬虫:scrapy genspider -t crawl spiname(爬虫名) xxx.com (爬取域)

运行爬虫:scrapy crawl spiname -o file.JSON

- 创建项目:scrapy startproject proname(项目名字,不区分大小写)

- 明确目标 (编写items.py):明确你想要抓取的目标

- 制作爬虫 (spiders/xxspider.py):制作爬虫开始爬取网页

- 存储内容 (pipelines.py):设计管道存储爬取内容

- 添加启动程序文件(start.py):等同于此命令(scrapy crawl xxx -o xxx.json),from scrapy import cmdline cmdline.execute("scrapy crawl 项目名".split())

- 因为使用的yield,而不是return。parse函数将会被当做一个生成器使用。scrapy会逐一获取parse方法中生成的结果,并判断该结果是一个什么样的类型;

- 如果是request则加入爬取队列,如果是item类型则使用pipeline处理,其他类型则返回错误信息;

- scrapy取到第一部分的request不会立马就去发送这个request,只是把这个request放到队列里,然后接着从生成器里获取;

- 取尽第一部分的request,然后再获取第二部分的item,取到item了,就会放到对应的pipeline里处理;

- parse()方法作为回调函数(callback)赋值给了Request,指定parse()方法来处理这些请求 scrapy.Request(url, callback=self.parse);

- Request对象经过调度,执行生成 scrapy.Http.response()的响应对象,并送回给parse()方法,直到调度器中没有Request(递归的思路);

- 取尽之后,parse()工作结束,引擎再根据队列和pipelines中的内容去执行相应的操作;

- 程序在取得各个页面的items前,会先处理完之前所有的request队列里的请求,然后再提取items;

- 这一切的一切,Scrapy引擎和调度器将负责到底。

至此。转载请注明出处。

0